- Sobota, 26. april 2025

- Delo home

-

Neomejen dostop | že od 14,99€

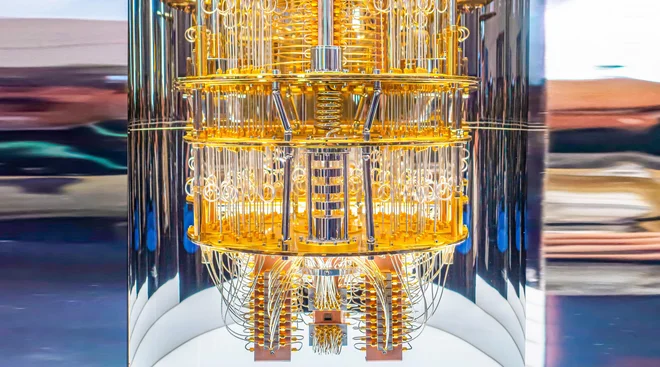

Boj z napakami v kvantnih čipih

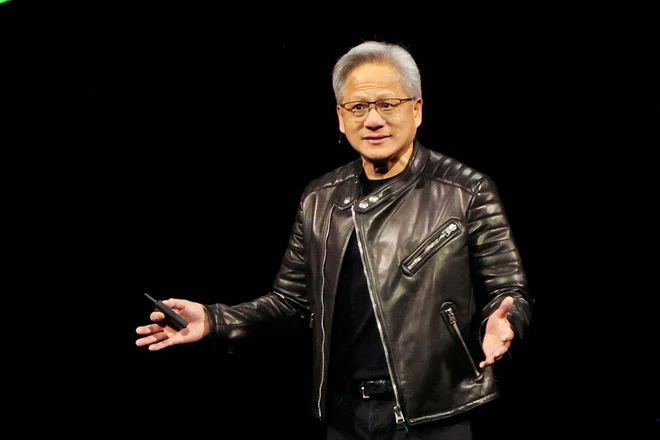

Na lasvegaškem sejmu potrošne elektronike CES, v začetku januarja, je direktor razvijalca čipov Nvidie, Jensen Huang, navrgel, da nas od širše uporabnih kvantnih računalnikov ločita še najmanj dve desetletji. Izjava je delniške tečaje s tem povezanih podjetij nemudoma pahnila v prepad.

Delnice ameriških zagonskih družb, kot sta Rigetti in IonQ, so v enem dnevu izgubile tudi do štirideset odstotkov vrednosti, Huangova izjava pa je v celotnem sektorju tisti dan izbrisala osem milijard ameriških dolarjev tržne vrednosti. V burnih odzivih smo lahko slišali pritožbe, da je bila poteza sebična, kajti Nvidia in kvantni tekmeci si zvečine delijo isti vlagateljski denar, kar pomeni, da so naložbe, ki gredo v mlada podjetja za kvantno računalništvo, po vsej sili tiste, ki ne gredo v smeri Nvidie. Toda po drugi strani ne gre spregledati, da je trenutno najrazvpitejši računalniški velikan – čeprav ni znano, da bi resno razvijal lastne kvantne procesorje – tudi sam bistveno vpet v to področje. Nvidijine čipe namreč kvantna podjetja pogosto uporabljajo v sklopih podporne elektronike, na primer za preverjanje izračunov. Huang ima tako precej dober uvid v področje.

Hitri tečaj kvantnih računalnikov

Da bi lažje razumeli glavne razvojne ovire v panogi, je najprej treba orisati način, kako kvantni računski stroji delujejo. Temeljna razlika glede na klasične, torej obstoječe računalnike, tako tiste za poganjanje iger doma kot one, na katerih slonijo internetni oblaki, je v tem, da za obdelavo podatkov bistveno izkoriščajo nekatere principe kvantne fizike. To je sprva najbolj opazno v njihovem načinu shranjevanja informacij. V klasičnem računalniku je najmanjša enota podatkov bit, ki ima lahko vrednost 0 ali 1, zato popularno pravimo, da je računalništvo neskončno premlevanje ničel in enic. Kvantni procesor pa informacije shranjuje v bistveno drugačni obliki: v kvantnih bitih oziroma kubitih. Tudi ti znajo nositi vrednosti 0 in 1 … toda poleg tega še kvantno superpozicijo teh dveh vrednosti, kar je še najbolj primerno razumeti kot vse vrednosti med 0 in 1 hkrati. Ena od možnih analogij za kanec lažjo predstavo je tista z valom vode na gladini: če ga pomerimo zgolj v eni od dveh prečnih smeri, dobimo le del informacije o njegovem dejanskem potovanju.

Takšna sorta obdelave podatkov se torej naslanja na kvantnofizikalne zakonitosti, ki so za laike običajno sila neintuitivne. V zameno dobimo zmogljivosti za nekatere, vsaj na papirju, izjemne računske prijeme. Najprej za neposrednejše ponazoritve kvantnofizikalnih razmer, kakršne vladajo v materiji in katerih simulacije v klasičnih računskih napravah nosijo nekatere bistvene omejitve. Nadalje pa za orjaške pospeške v računanju raznih matematičnih problemov, ki bi tudi od današnjih najboljših superračunalnikov zahtevali stoletja garanja. Ta princip se v osnovi naslanja na lastnost večjih gruč kubitov, da se zmorejo družno postaviti v superpozicijo vseh možnih vrednosti v skupini. V klasičnem računalniku lahko n bitov nosi številsko vrednost, ki pade v 2 na n-to potenco možnih vrednosti. V kvantnem računalniku pa lahko skupina n kubitov teoretično nosi 2 na n-to potenco vrednosti naenkrat. Ne le to – tudi računa lahko s toliko vrednostmi hkrati!

A da je mera polna, je postopek takšnega računanja spričo kvantnih pravil bistveno bolj zapleten kot v klasični napravi. Da se lahko kubiti postavijo v opisano skupno superpozicijo, morajo biti običajno prepleteni, kar je oznaka za stanje, ko sprememba pri enem kubitu sproži še spremembo v drugem, ne glede na razdaljo med njima, kar je Alberta Einsteina zelo razburjalo in je bilo eden od vzrokov, da je imel s področjem kvantne mehanike »kompliciran« odnos. Predvsem pa: če želimo pomeriti dejansko vrednost informacije v kubitu, s tem kvantno superpozicijo neobhodno podremo, saj takrat vse vrednosti popadajo bodi v 0 bodisi v 1. Delovanje kvantnih računalnikov se tako torej deli v fazo računanja, v katero ne smemo na silo bezati, sicer ga nepopravljivo zmotimo, in v fazo branja rezultatov. Tako pridobljene vrednosti je nato treba še preveriti s klasičnimi računalniki – za kar se danes vse bolj uporabljajo v uvodu omenjeni Nvidijini čipi.

Grozna občutljivost

Trenutno smo v tehnološki fazi, ko ni jasno niti to, kako bi bilo kubite sploh najbolje zgraditi. Obstaja namreč množica različnih predlogov in stvarnih izvedb, kot so ioni, ki jih nadzorujejo z elektromagnetnimi rešetkami; pa nevtralni atomi, ki jih premetavajo naokoli z laserskimi pincetami in ki vrednosti shranjujejo v spinu. Najpogostejši pristop v tej industriji pa je še vedno tisti s transmoni, kar je oznaka spoja superprevodne zanke in votline, skozi katero z mikrovalovno svetlobo nadzorujejo električni tok v zanki. Superprevodno delovanje takšnega sklopa je eden od vzrokov, da so tovrstne naprave dandanes zaprte v izjemno zapletene hladilnike, ki jih držijo na temperaturi delčkov stopinje nad absolutno ničlo. Toda ohlajanje je tod koristno v splošnem, saj tako umirjena materija manj dreza v kubite in tam shranjene vrednosti. Treba je namreč vedeti, da lahko kvantno superpozicijo poruši že najmanjša zunanja motnja in s tako povzročeno dekoherenco na mah uniči celoten izračun.

Prav velika dovzetnost za motnje je poglaviten vir inženirskih problemov v panogi in glavni vzrok, da razvoj na videz teče tako zelo počasi. Manjše skupke kubitov, to je od nekaj deset do okoli tisoč, znajo vodilna podjetja danes sicer zanesljivo izdelati, toda skladno z njihovim povezovanjem v neko uporabno celoto skokovito raste tudi občutljivost za motnje ter s tem povezane računske napake. To je bilo mogoče opazovati v praksi skozi objave velikanov: v prejšnjem desetletju sta Google in IBM javno tekmovala, kateri bo izdelal čip s čim več kubiti, kajti od njihovega števila je v osnovi najbolj odvisna gola računska moč takšnih naprav. Okoli leta 2020 pa je nastopila jasna streznitev, da surovo število kubitov ne pomeni kaj dosti, če niso zmožni zanesljivega delovanja oziroma niso spodobno odporni proti napakam. V zvezi s tem je pomenljiv način, kako v IBM zadnje čase ponazarjajo svoj napredek. Konec leta 2023 so predstavili dva poglavitna čipa: condor je 1121-kubitni čip, ki predstavlja golo proizvodno zmogljivost; 133-kubitni heron pa čip, ki ga je mogoče tudi praktično uporabljati. Pred nekaj meseci so pokazali drugo generacijo herona, ki je prilezel do 156 kubitov.

Kvantni popravki

Vse od začetkov raziskav so v stroki stalno prisotna mnenja, da nam bo to v končni fazi popolnoma preprečilo uporabno izvedbo naprav, ki bi zmogle izvajati zares prelomne kalkulacije. Za prebojne zmogljivosti, ki bi, denimo, strle današnje šifrirne algoritme, bi potrebovali najmanj na desettisoče ali celo stotisoče sodelujočih odpornih kubitov. »Področje sloni na špekulativni tehnologiji in verjetno ne bo nikoli obrodilo sadov,« trdi Mihail Djakonov, eden najrazvpitejših skeptikov. Toda treba je vedeti, da so takšnih pomislekov raziskovalci že vajeni, a tehnologijo vseeno neutrudno poganjajo dalje. Petru Shoru, najslavnejšemu teoretiku kvantnega računalništva, so takoj po tem, ko je leta 1994 predstavil prvi algoritem, s katerim je pokazal potencialne prednosti kvantnih računalnikov pred klasičnimi, očitali, da takšna reč zaradi občutljivosti za motnje nikoli ne bo mogla delovati v praksi. Shor se je leto pozneje odzval s prvim primerkom algoritma za popravljanje kvantnih napak in zagnal istoimensko podpanogo (quantum error correction, QEC).

Tudi v klasičnem računalništvu je odpravljanje napak pomembna veja raziskav in razvoja, saj v naših računalnikih in telefonih namenski sklopi čipov stalno preverjajo, ali po cevovodih potujejo pravilna zaporedja ničel in enic. V kvantnih napravah je takšno preverjanje znatno bolj zahtevno, saj kubitov ne smemo neposredno povprašati o njihovi vrednosti, ker bi jih s tem zmotili oziroma dokončno prebrali. Peter Shor je v svojih uvodnih izvedbah algoritmov za popravljanje kvantnih napak zato uporabil princip primerjav med enakovrednimi kubiti. To se pravi: informacijo je vzporedno »varnostno« zapisal v več kubitov in med delovanjem preverjal, ali imajo vsi še vedno enako vrednost. To lahko ponazorimo s primerom treh krogel iste barve, od katerih pa ima ena rahlo drugačno maso. Z izmeničnim postavljanjem na tehtnico je mogoče ugotoviti, katera je takšna.

Shor je s skupkom kubitov, ki varnostno nosijo isti kos podatkov, zasnoval pojem tako imenovanega logičnega kubita. S tem označujemo funkcionalen kubit, ki je odporen proti napakam, a je v resnici zgrajen iz večjega števila dejanskih fizičnih kubitov, ki so namenjeni tako nošnji informacije kot boju proti napakam. Do današnjih dni je področje porodilo kopico različnih receptov, po katerih bi takšni logični kubiti lahko bili zgrajeni. Najpogostejši trenutni pristop se imenuje površinsko kodiranje (surface code). Tu je en logični kubit, zgrajen iz dveh vzporednih mrež fizičnih kubitov; prva mreža hrani podatke, druga pa nadzoruje, ali kje nastajajo napake. Najmanjša izvedba takšnega logičnega kubita vsebuje sedemnajst fizičnih, največje več kot tisoč. Različne zasnove logičnih kubitov v splošnem danes vsebujejo približno od pet kubitov do štiri tisoč kubitov, zato je mogoče začutiti, da so raziskave zelo živahne – pa tudi tehnična cena, ki jo od inženirjev zahteva popravljanje napak. Od tod razlika v številu kubitov med zgoraj omenjenima condorjem in heronom.

Večni trud

V zadnjih dveh letih se tako skoraj vse objave družb za kvantno računalništvo, od Googla do IBM in Rigettija, vrtijo okoli spopadanja z napakami. V Microsoftu so se lansko jesen osredotočili na dokazovanje principov popravljanja napak na kubitih, zgrajenih iz ionov in nevtralnih atomov, ki jih zanje proizvajajo v podjetjih Quantinuum in Atom Computing. Januarja letos so ponovno oznanili domnevno delujočo izvedbo kubitov na podlagi za zdaj še špekulativnih kvazidelcev, ki jih imenujemo majorane. Čeprav njihov obstoj tudi tokrat še ni bil docela potrjen in okoli tega v stroki poteka burna razprava, je pomenljiv motiv Microsofta za razvoj takšne tehnologije: njeni kubiti so teoretično izjemno stabilni in s tem odporni proti motnjam. Pri IBM so pokazali že omenjenega herona revizije 2 in kopico spremljevalnih načinov za zmanjševanje napak.

Tako ni presenetljivo, da je tudi najpomembnejše odkritje v zadnjem času povezano ravno z – odpravljanjem kvantnih napak. Decembra lani so se v Googlu dokopali do dolgo želenega empiričnega dokaza, da so uporabni logični kubiti v njihovih arhitekturah s transmoni, ki uporabljajo površinsko kodiranje, sploh izvedljivi. To se pravi: dokazali so, da odpornost logičnega kubita v resnici raste s številom fizičnih kubitov, iz katerih je zgrajen. To doslej še zdaleč ni bilo samoumevno, saj morajo biti že fizični kubiti sami zase do neke mere odporni, nato pa potrebujemo še zmogljiv recept, kako jih med seboj pravilno povezovati. Drugače je dodajanje fizičnih kubitov blažev žegen in od logičnega kubita nimamo nič. Googlov dokaz je pomemben mejnik na poti do uporabnih kvantnih računalnikov, a kot poudarjajo tako rekoč vsi strokovni komentatorji, je to šele začetek poti. Jensen Huang, ki je sicer vse bolj razvpit zaradi svojih teatralno pretiranih komentarjev dogajanja v računalništvu, se tokrat verjetno zares ni pretirano uštel.

Komentarji